Возможно, вы недавно видели видео, где лицо Николаса Кейджа переносится на другого персонажа, выполняющего раунды в интернете. Нет, мы не имеем в виду отрывок из фильма Face/Off. Это сцены из разных фильмов, в которых Николас Кейдж точно не играл, но выглядят они действительно очень убедительно. Как им это удалось?

Ну, ответ не «колдовство», а технология, которую окрестили «дипфейком», и она вызывает настоящий шум в различных отраслях и сообществах.

Что такое «дипфейк»?

Слово «дипфейк» происходит от термина «глубокое обучение» и, конечно же, «фейк». Глубокое обучение – это специализированная отрасль машинного обучения, которая также является частью общей области искусственного интеллекта.

Благодаря резкому росту вычислительной мощности и новым способам обработки и анализа огромных объемов данных из реального мира компьютеры теперь внезапно могут делать то, что большинство из нас даже не могло себе представить. Дипфейки применяют эту технологию для синтеза человеческих образов, создавая фотографии или видео того, что эти люди никогда не делали и никогда не говорили.

Как работает технология Deepfake?

Глубокое обучение, лежащее в основе методов deepfake, описывает современное применение моделирования нейронных сетей к огромным наборам данных. Нейронные сети не являются новой концепцией или технологией, но до наших дней они были довольно рудиментарными.

Искусственная нейронная сеть, по крайней мере, в некоторой степени имитирует процесс обучения, происходящий в биологическом мозге. Когда вы учитесь или иным образом взаимодействуете с внешним миром, связи между клетками вашего мозга меняются.

Они образуют схемы и логические структуры, усиливая одни связи и ослабляя другие. Когда вы что-то осваиваете, например, учитесь водить машину или играть в теннис, эти мозговые процессы становятся быстрыми и эффективными. В конце концов вы настолько хороши в чем-то, что вам даже не нужно думать об этом.

По сути, это то же самое, что происходит с системой глубокого обучения. Он рассматривает кучу примеров чего-либо, а затем постепенно становится лучше «понимать это».

В случае дипфейков программа просматривает примеры лица, которое вы хотите транспонировать, а также видео, в которое вы хотите его транспонировать. При достаточном обучении он может в конечном итоге синтезировать лицо, соответствующее обучающим данным, а затем легко наложить его на любое другое лицо..

Какое программное обеспечение используется для создания дипфейков?

Существует ряд приложений, которые позволяют людям делать дипфейки. FakeApp было первым известным нам приложением, целью которого было дать обычным людям возможность создавать дипфейковый контент. Веб-сайт сейчас закрыт, и найти его копию совсем непросто.

Сейчас создатели дипфейков в основном перешли к приложению под названием DeepFaceLab, которое размещено на GitHub и породило бесконечный поток обучающих материалов на таких сайтах, как Reddit.

Создание дипфейка

Эта статья не является учебным пособием, поэтому мы дадим обзор того, как на практике создаются дипфейки, но не опишем точных шагов, как сделать их самостоятельно.

Причин этому несколько, но главная из них заключается в том, что законность создания дипфейков весьма спорна. Точно так же, как мы не даем точных инструкций по пиратскому программному обеспечению или совершению других незаконных действий, мы не будем давать пошаговые инструкции по созданию дипфейков.

Кроме того, настоящий создатель DeepFaceLab выпустил версию пошаговый видеоурок для программного обеспечения, за которой может следить каждый, если он желает взять на себя ответственность за такой риск.

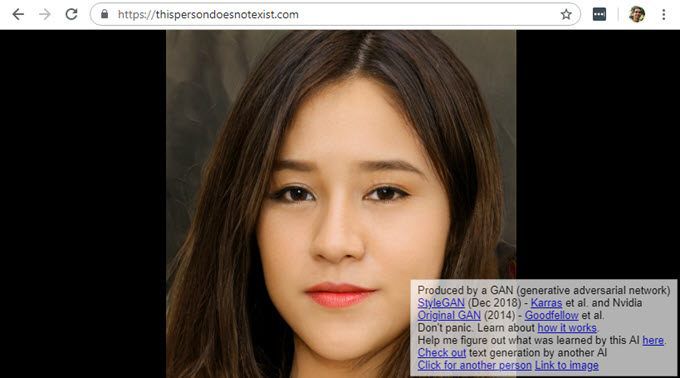

Чтобы понять, насколько хороша эта штука, загляни на этот сайт где при обновлении страницы создается новая фотография несуществующего человека.

Наша цель — помочь вам понять эту технологию, поскольку с течением времени вы обязательно будете сталкиваться с ней все чаще. С учетом вышесказанного, это общие этапы создания дипфейка с помощью DeepFaceLab.

После загрузки и распаковки DeepFaceLab вы обнаружите папку, содержащую множество других папок и ряд пакетных файлов.

Есть папка под названием «Рабочая область», которая содержит обучающие модели, исходные видео и выходные данные. DeepFaceLab работает с определенными именами и местоположениями файлов, чтобы пакетные файлы могли работать. Например, исходный файл всегда называется «data_src», а целевой — «data_dst».

Не существует программного интерфейса, который знаком большинству людей. Просто список пронумерованных пакетных файлов, представляющих этапы процесса. Сначала кадры исходного и целевого видео извлекаются в виде файлов изображений.

Затем выполняются несколько этапов анализа, за которыми следует обучение на базе графического процессора, в ходе которого нейронная сеть узнает, что ей нужно о лицах в двух видео, чтобы построить модель. Наконец создается новое составное видео..

Неправомерное использование дипфейков

Как мы уже упоминали выше, дипфейки очень противоречивы. Это может нарушать существующие законы в некоторых странах, и в разработке находятся новые законы, регулирующие эту технологию и ее применение.

Дипфейки можно использовать для создания мистификаций, таких как видео президента, говорящего сумасшедшие вещи. Его можно использовать для вставки людей в порнографические фильмы с целью их преследования или иного вреда.

Как вы, наверное, можете себе представить, вы можете нанести большой вред убедительным дипфейком, и последствия, если вас поймают, могут стать гораздо более серьезными в ближайшем будущем.

Все задавать вопросы

Теперь, когда эта технология существует и работает так же хорошо, это означает, что мы должны взглянуть на такие медиа, как видео, в совершенно новом свете. Если кто-то распространяет в социальных сетях видео, на котором известный человек или политик говорит или делает что-то противоречивое, вам сначала придется спросить, настоящее ли это видео вообще.

Большинство плохо сделанных дипфейков явно являются фейками, если знать, на что обращать внимание, и видеть некоторые из них. Однако в некоторых случаях даже опытный глаз может не заметить, что происходит какая-то манипуляция компьютерной графикой, и по мере совершенствования технологии это в конечном итоге станет невозможным.

.